本記事では、長い文脈を扱えるLLMをRAGシステムで活用する際の課題と可能性についての研究結果を紹介します。

より多くの関連情報を提供すればLLMの回答の質が向上すると考えられがちですが、実際にはそう単純ではないことが明らかになってきました。

そこで研究者たちは、長い文脈を扱えるLLMの特性を活かすための新しいアプローチの開発に取り組んでいます。

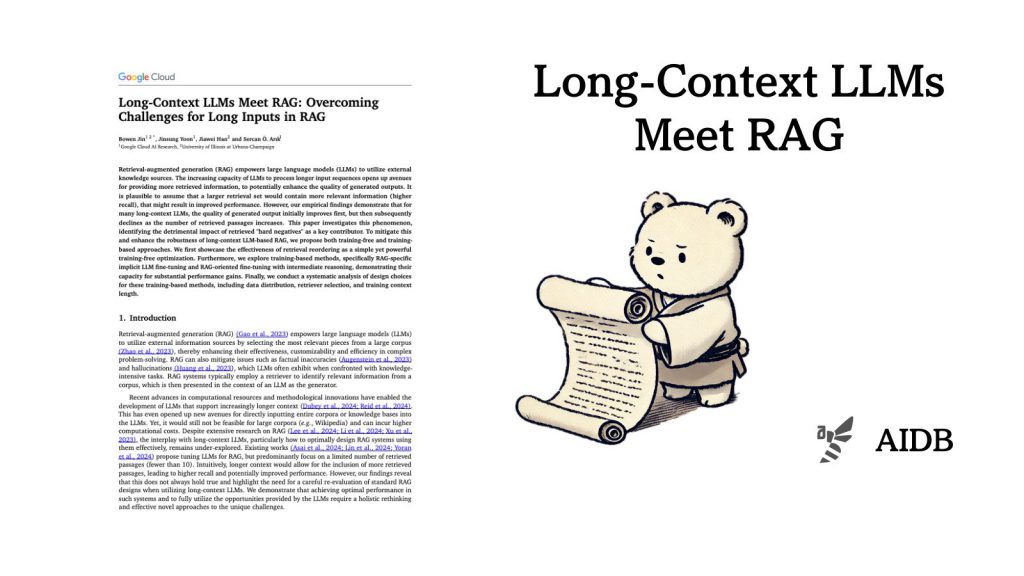

参照論文情報

- タイトル:Long-Context LLMs Meet RAG: Overcoming Challenges for Long Inputs in RAG

- 著者:Bowen Jin, Jinsung Yoon, Jiawei Han, Sercan O. Arik

- 研究機関:Google Cloud AI Research, University of Illinois at Urbana-Champaign

背景

RAGはLLMの能力を拡張する手法として注目されています。外部の知識ソースを活用して、より正確で信頼性の高い回答を生成できるようにする技術です。

さらに、最近登場しつつある「長い文脈を処理できるLLM」を使えば、RAGシステムで多くの情報を一度に取り込むことができます。一般的には、多くの情報をもとにすれば、LLMの回答の質が向上すると考えられがちです。

しかし、実際の長文脈LLMを用いたRAGシステムの設計については、まだ十分な研究がなされていません。

また、長文脈LLMの能力を評価するためのベンチマークは、実際のRAGシステムで直面する課題を十分に反映していないという問題もあります。

このような背景から、今回Googleなどの研究者たちは長文脈LLMを用いたRAGシステムの性能を詳細に分析し、その課題を明らかにする必要があると考えました。さらに、課題を解決するためのアプローチの開発に取り組みました。

以下で詳しく紹介します。