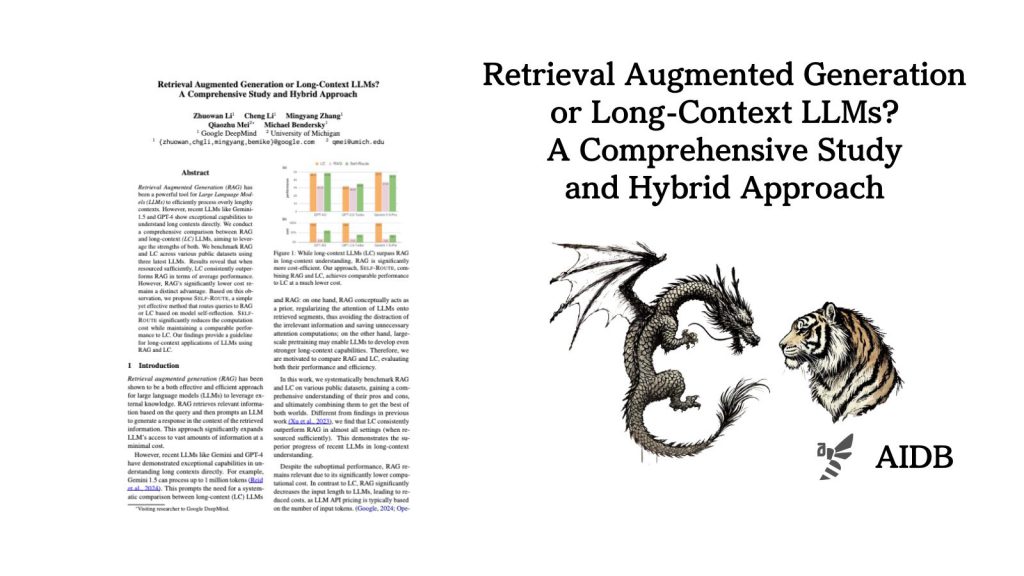

本記事では、RAG(検索拡張生成)と、ロングコンテキストLLM(長文を処理できる大規模言語モデル)を比較した最新研究を紹介します。

Googleの研究者らは、複数のベンチマークデータセットを用いてRAGとロングコンテキストLLMの性能を評価し、さらに両者の長所を組み合わせたアプローチ「Self-Route」を提案しています。

またRAGの失敗原因の詳細な分析なども含めた多角的な考察が行われています。

参照論文情報

- タイトル:Retrieval Augmented Generation or Long-Context LLMs? A Comprehensive Study and Hybrid Approach

- 著者:Zhuowan Li, Cheng Li, Mingyang Zhang, Qiaozhu Mei, Michael Bendersky

- 所属:Google DeepMind, University of Michigan

背景

最近、LLMに長文を理解させることが注目を集めています。LLMの長文理解に対しては、RAGとロングコンテキストLLMの2つがアプローチとして該当します。

RAGは、入力されたクエリに関連する情報を外部のデータベースから検索し、その情報をもとにLLMが回答を生成します。外部知識にアクセスすることで、効率的に長文を処理することが可能となります。

ロングコンテキストLLMについては、最新のLLMモデルであるGeminiなどは、直接数百万トークンもの長い文脈を理解する能力を示しています。

RAGとロングコンテキストLLMにはそれぞれ長所と短所があります。RAGは計算コストが低いという長所がありますが、複雑な推論を要する質問に対しては性能が劣る場合があります。一方、ロングコンテキストLLMは高い性能を示す一方で、計算コストが高くなるという問題があります。

今回研究者らは、RAGとロングコンテキストLLMの性能と効率性を様々な公開データセットで徹底的に比較しました。さらに、両者の長所を活かすハイブリッドアプローチも提案しています。